我們已進入了 AI (人工智能)世代,至少我們已進入了熱烈討論 AI 的世代。AI 可以做這,可以做那:在遊戲上戰勝人類、管理家居、編寫維基、寫劇本、評論小說……正當大家在擔心 AI 會否超越人類,在此以前,還要擔心多一項事情,勿要讓 AI 成為法西斯的工具。

微軟研發員 Kate Crawford 早前成立了專門研究 AI 與社會影響的組織 AI Now,她在上週日的美國 SXSW 大會發表演講,題為「黑暗日子:人工智能與法西斯主義的崛起」,解釋自動化系統以及預先編寫的程式如何有可能遭誤用,特別是落入別有用心的人手上。

Crawford 稱,在 AI 興起的同時,民族主義、右翼威權主權與法西斯主義也同時崛起。而以上運動都有共同性質,都是希望集中權力、追蹤民眾、妖魔化外人、提倡威權以及不受外力約束。AI 則可以成為助長極權的有力工具。

其中一個重大問題是 AI 的程式難以避免人為偏見,她以上海交通大學一項具爭議的研究為例,研究員聲稱開發了一套程式,可以基於面部特徵預測誰人有機會是罪犯。機器以中國政府的身分證相片來分析罪犯與非罪犯的面貌,從而得出所謂的「關鍵特徵」,據說以貌取人的準確度高達 89.51 %。

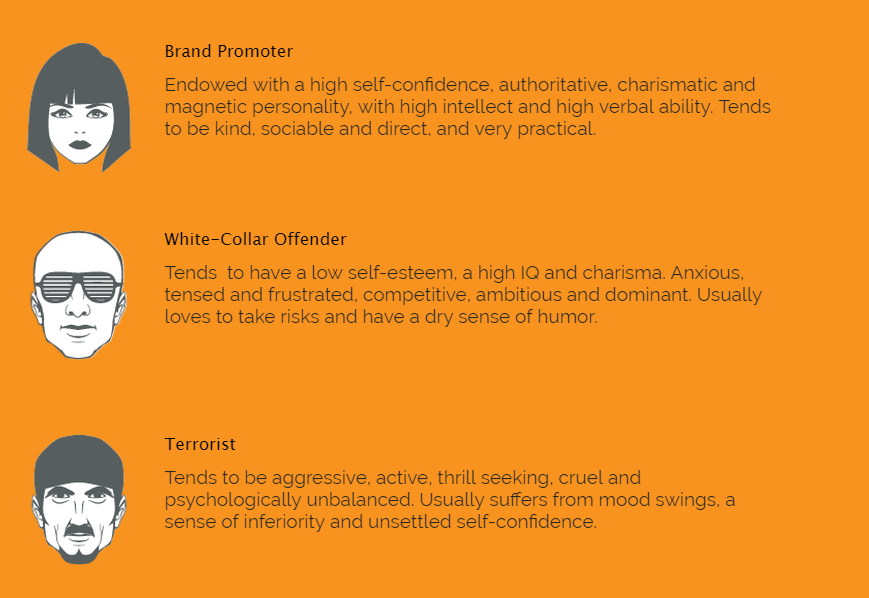

上海交大的研究結果顯示,罪犯的面部特徵的確是異於常人。不過 Crawford 解釋,法官和警察對於奇異長相的人通常信任度也較低,這就是所謂「編碼偏見」,她說:「在獨裁者手上,這將會是一套可怕的軟件。」科技公司 Faception 聲稱能按人的面相分析性格,在網頁上的介紹顯示,中東相貌及留鬍鬚的人屬於「恐怖分子」,傾向具侵略性、兇惡、心理不平衡。

另一樣令 Crawford 擔心的是,AI 或讓人有機會用來標籤個別族群。就像歷史上 IBM 曾向納粹德軍提供技術支援,如計算「每日應有多少猶太人從隔離所中消失」的打卡機,及南非種族隔離所用的人口註冊表。舉例說,假如杜林普希望標示出在美國所有的穆斯林公民,或可利用 Facebook 上的痕跡,如劍橋大學 2013 年的一項研究表示,基於用戶在社交網絡上的「讚好」某程度可猜測他們的宗教信仰。基督教徒與穆斯林教徒有 82% 的個案可分辨,與分辨用戶是民主黨還是共和黨的結果相若(85%)。

還有一樣與政治相關的憂慮是,通過分析大數據,掌握選民喜好和習慣,讓社交網絡與搜尋廣告等宣傳攻勢更有效,左右關鍵選民選擇。例如各國公投議案中屢屢出現比例相若的結果,對議題沒有深入認識,很容易因接收到的有限資訊便決定投票意向。Crawford 擔心,這利用心理分析數據來左右人民看法的技術,在未來數年或會完全實現,這是法西斯所夢寐以求的,因此她認為我們有必要讓這些 AI 系統更透明及對社會負責。